NDLR : ce cours traite de l’élément essentiel de l’IA, cours important mais non essentiel !

Les scientifiques ont compris que pour créer des systèmes d’intelligence artificielle capables d’apprentissage, il fallait imiter la structure des réseaux de neurones du cerveau. Les perceptrons étaient un pas dans cette direction, car ils modélisaient la façon dont les neurones pouvaient être connectés pour effectuer des calculs simples.

En 1957, Frank Rosenblatt a inventé le perceptron, un modèle mathématique simplifié d’un neurone biologique. Il a conçu le perceptron pour qu’il puisse prendre des entrées, les pondérer et produire une sortie binaire.

De quoi s’agit-il ?

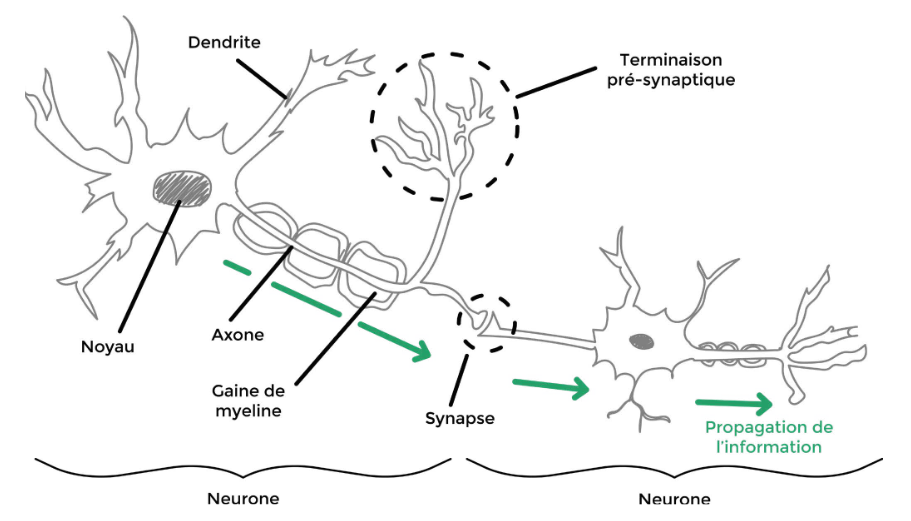

Voici un schéma de neurones biologiques et de la propagation de l’information (schéma 1) :

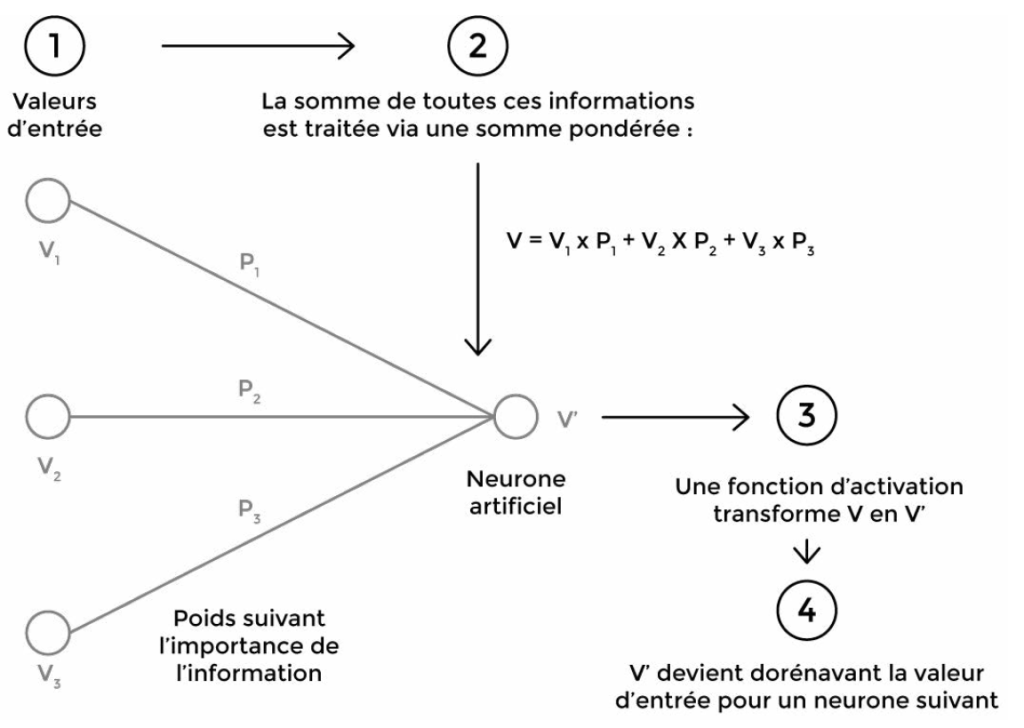

Exemple de schéma d’un neurone artificiel (schéma 2):

La fonction d’activation peut par exemple être une fonction de seuil.

En clair, si V est supérieur à un seuil fixé appelé aussi biais, le neurone s’active en prenant la valeur 1 ( et 0

dans le cas contraire). Les biais et les poids sont donc les paramètres du neurone artificiel.

Mais alors comment un neurone artificiel peut-il apprendre quelque chose ?

Comme un neurone réel avec un système de sanction / récompense !

Dans le cas de notre neurone artificiel (schéma 2), il suffit d’avoir un jeu de données d’entrée conséquent (une multitude de triplets (V1, V2, V3)) avec son jeu de résultats de sortie (correct, incorrect). A chaque triplet, en fonction du résultat on modifie les poids (P1, P2, P3) jusqu’à obtenir les poids optimums.

Vous savez tout sur le perceptron, enfin presque ( en savoir plus ici !).